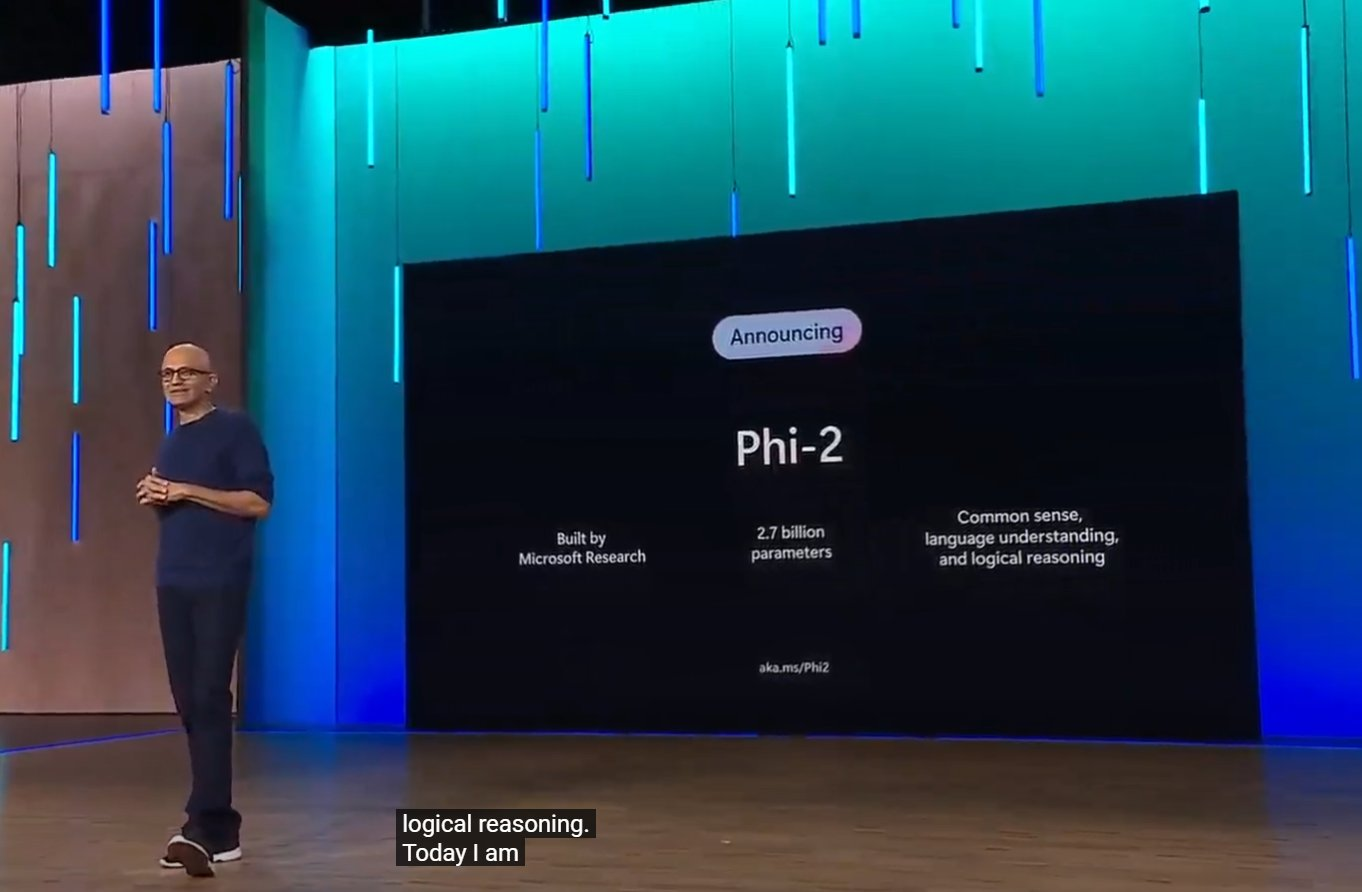

AIBetas消息,11月16日,在微软 Ignite 2023 大会上,微软发布了旗下最小的语言模型 Phi-2,共有 27 亿参数。

![图片[1] - 微软发布 Phi-2 模型,27亿参数,部分性能明显提升 - AIBetas](https://www.aibetas.com.cn/wp-content/uploads/2023/11/image-101-1024x671.png)

微软于今年 6 月发布 Phi-1,只有 13 亿参数,适用于 QA 问答、聊天格式和代码等等场景。该模型完全基于高质量数据进行训练,在基准测试中的表现比同类模型高出 10 倍。

微软今年 9 月更新发布了 Phi-1.5 版本,同样为 13 亿参数,可以写诗、写电子邮件和故事,以及总结文本。在常识、语言理解和推理的基准测试中,该模型在某些领域能够跟上多达 100 亿个参数的模型。

Phi-2 与 Phi-1.5能力对比

- 更多参数:Phi-2 的参数是 Phi-1.5 的两倍,这意味着它可以更好地获得语言的细微差别。

- 强大的性能:它已经过测试,表明它几乎可以与最好的 AI 模型相媲美。

- 更好的安全性:它在处理任务方面更安全、更智能。

Phi-2 允许开发人员执行以下操作:

- 获得准确的答案: 它可以理解复杂的问题并给出更准确的答案。

- 安全构建:它对安全性的关注使其成为需要仔细处理内容的应用程序的可靠选择。

Microsoft 的 Phi-2 模型,以及 Nvidia 的更新和混合循环开发模式,为 Windows 上的 AI 设定了新的方向。开发人员现在拥有的工具不仅功能强大,而且更易于使用且更安全。这导致了一个人工智能可以做更多事情并在日常任务中更有帮助的未来。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容