AIBetas消息,11月6日,OpenAI第一次开发者大会正式召开,大会上正式发布了GPT-4 Turbo,全新开放的API接口,以及 GPTS等众多产品内容的更新。OpenAI表示,目前有大概200万开发者,在500强中有92%用了GPT改善工作流,周活有将近1亿用户。

本次大会一些主要更新内容汇总:

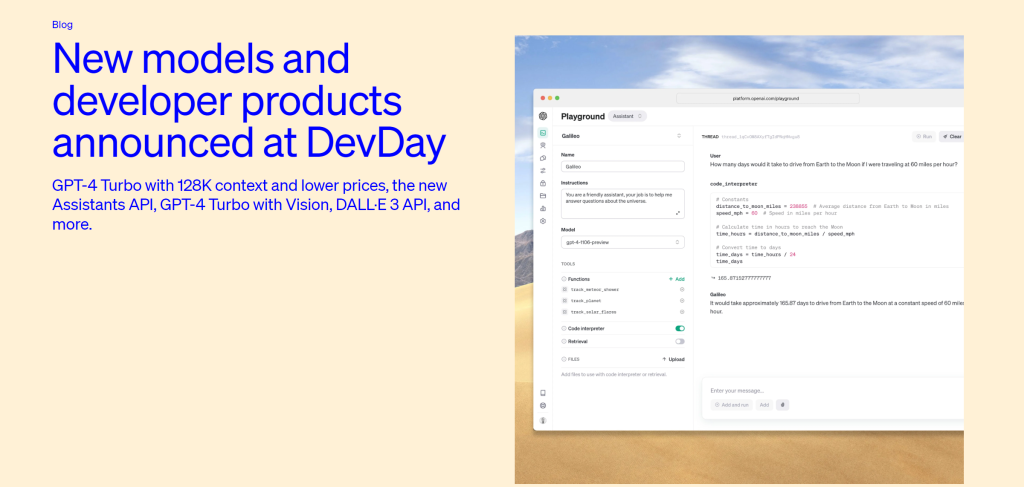

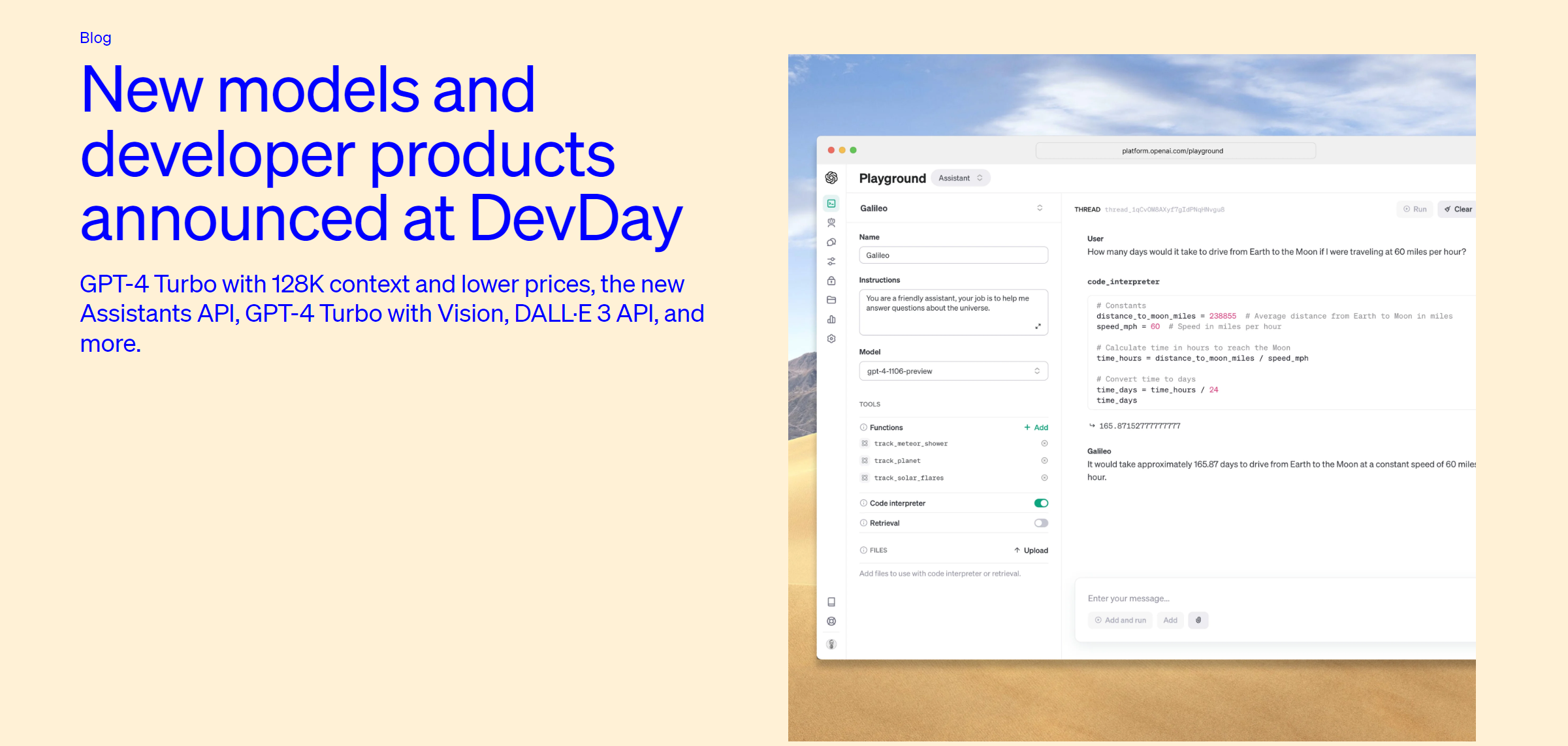

- GPT-4 Turbo模型:OpenAI推出了GPT-4 Turbo模型,这是其语言模型的下一代。它更加强大且更具成本效益,提供了128K上下文窗口,使其能够在单个提示中理解更大量的文本。此模型还具备截止到2023年4月的全球事件知识。

- 助手API:OpenAI发布了助手API,允许开发人员为各种任务创建定制的AI助手。这些助手可以具有特定的指令,利用外部知识,并调用模型和工具执行操作。它支持功能,如代码解释器、检索和函数调用。

- 多模态能力:该平台现在支持多模态功能,包括视觉、图像生成(DALL·E 3)和文本转语音(TTS)。GPT-4 Turbo可以接受图像作为输入,开发人员可以直接集成DALL·E 3到其应用程序中。还提供了一个TTS API,用于从文本生成人类质量的语音。

- 函数调用更新:函数调用的改进允许用户在单个消息中调用多个函数,提高了效率。GPT-4 Turbo在返回正确的函数参数方面更加准确。

- 改进的指令遵循:GPT-4 Turbo在需要精确遵循指令的任务中表现更佳,例如生成特定格式。它还支持JSON模式,以生成语法正确的JSON输出。

- 可重现输出和对数概率:新的种子参数可以生成可重现的输出。OpenAI还将推出一个功能,用于返回生成的最可能输出标记的对数概率。

- 更新的GPT-3.5 Turbo:新版本的GPT-3.5 Turbo默认支持16K上下文窗口,具有改进的指令遵循、JSON模式和并行函数调用。

- 模型定制:OpenAI正在推出GPT-4微调的试验性访问计划。还推出了自定义模型计划,为需要进行广泛定制的组织提供机会。

- 降低价格和提高速率限制:OpenAI正在降低各种模型的价格,使其更加负担得起。对于GPT-4客户,速率限制已增加。

- 版权保护:OpenAI引入了版权保护,以保护客户免受与版权侵权相关的法律索赔的困扰。

- Whisper v3和一致性解码器:发布了Whisper大型-v3,这是一个具有改进性能的自动语音识别(ASR)模型。还计划在不久的将来在API中支持Whisper v3。此外,OpenAI还开源了一致性解码器,它是稳定扩散VAE解码器的替代品,可以改善文本、面部和直线等所有与Stable Diffusion 1.0+ VAE兼容的图像。

- GPTs(Generative Pre-trained Transformers):定制版本的ChatGPT,允许用户根据特定需求自定义ChatGPT的功能和行为。这些定制的GPTs可以用于不同的目的,如教育、工作、娱乐等,并且可以与他人分享。用户无需编程即可创建自己的GPT,通过简单的对话、指令和知识输入来定义其行为。GPTs的创建和分享对所有人都变得更加容易,无论是个人、公司内部使用还是公开分享。这个定制化的方法旨在使ChatGPT更加适应用户的具体需求和用途,从而提供更大的灵活性和有用性。同时,GPTs的隐私和安全性也得到了重视,用户有控制权来管理与GPTs的数据和与第三方API的互动。通过GPTs,用户可以更广泛地塑造AI的行为,促进社区参与,并为构建更安全和更符合预期的AI做出贡献。

这些更新增强了OpenAI模型的功能,使其更易于访问,并为开发人员提供了创建各种AI应用程序所需的额外工具和资源。该平台旨在支持各种用例,从自然语言理解到多模态任务和定制AI助手。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容