AIBetas消息,2023年8月8日,Stability AI宣布首次公开发布StableCode,这是其新的开放大型语言模型(LLM),旨在帮助用户生成编程语言代码,同时也为准备将技能提升到更高水平的新开发人员提供了一个很好的学习工具。

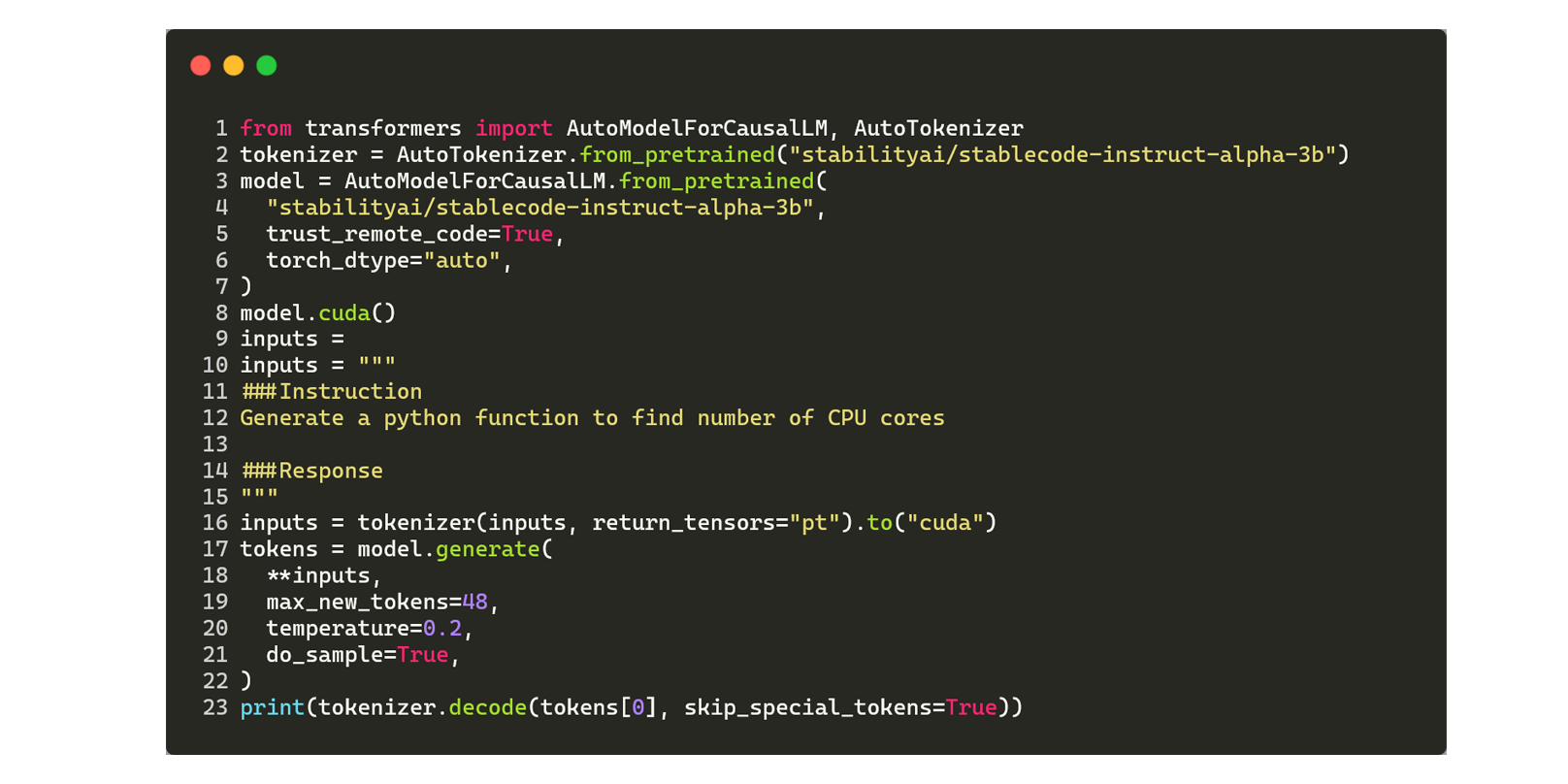

StableCode提供了一种独特的方式,通过使用三个不同的模型来帮助开发人员提高效率。首先,基础模型使用了来自BigCode的stack-dataset(v1.2)中多样化的编程语言进行了训练,然后进一步使用了流行的语言如Python、Go、Java、Javascript、C、markdown和C++进行了训练。总体上,在高性能计算集群上训练了560亿个代码单元的模型。

在建立了基础模型之后,进一步优化了指令模型,以解决复杂的编程任务。使用了约120,000个Alpaca格式的代码指令/响应对对基础模型进行了训练,以达到这个结果。

StableCode的长上下文窗口版本具有16,000个令牌的上下文窗口,Stability AI声称其比任何其他模型都大。Cooper解释说,更长的上下文窗口允许使用更专业和更复杂的代码生成提示。这也意味着用户可以让 StableCode 查看包含多个文件的中型代码库,以帮助理解和生成新代码。

StableCode 不是使用 ALiBi(线性偏差的注意力)方法来定位转换器模型中的输出(StarCoder 用于其开放式生成 AI 模型进行编码的方法),而是使用一种称为旋转位置嵌入 (RoPE) 的方法。

Cooper说,变压器模型中的ALiBi方法倾向于比过去的代币更重视当前的代币。在他看来,这不是代码的理想方法,因为与自然语言不同,代码没有一个有开头、中间和结尾的固定叙事结构。可以为应用程序流中的任何点定义代码函数。

StableCode官网

目前处于测试阶段,官方试用地址暂未公布。

暂无评论内容